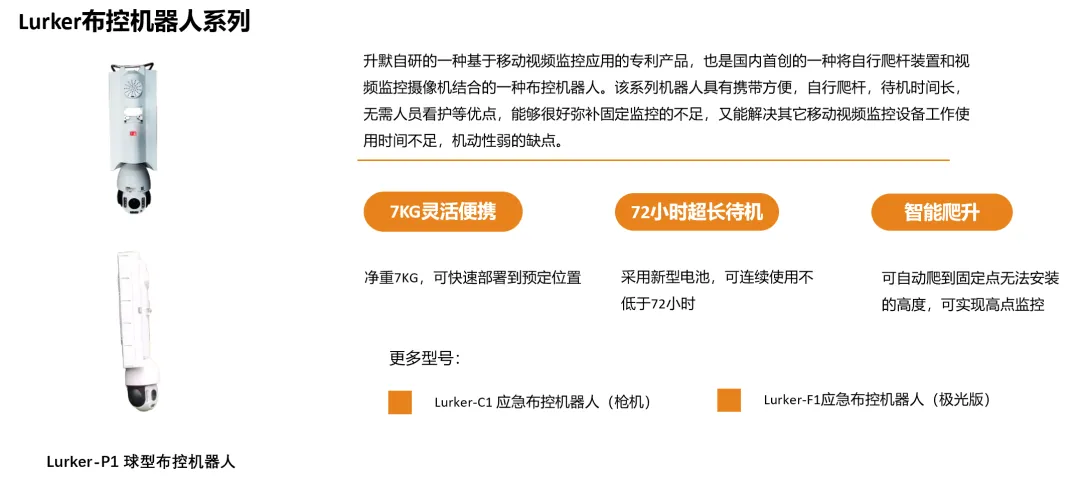

了解影响夜视摄像机亮度关键因素—新一代AI全彩夜视摄像机

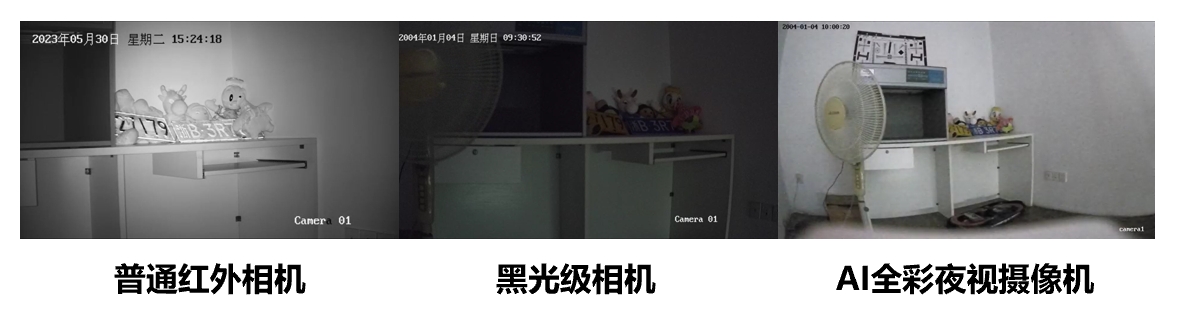

视频监控经过近几年的快速发展,白天在充足的日光下已解决”看得见、看得清”问题,正在进入”看得懂、不用看”阶段。同样夜视相机产品也迈过“看得见”阶段,进入“看得远、看得透、看得清、看得全、看得细”。传统夜视相机依靠红外与热成像技术多为黑白成像或弱彩,存在目标细节特征不明显等缺点。随着“夜生活”成为人们生活的重要部分,摄像机在夜间全彩的图像逐渐成为市场需求,突破夜间成像也成为业界的研究课题。今天就来简单介绍有哪些影响摄像机成像亮度关键因素。

1、镜头

- 镜头作为摄像机的重要组成部分,其是光线进入摄像机的第一道“关卡” ,其摄取光线的多少直接决定了成像的清晰度。而通常用“进光量”的大小来衡量镜头对光线的摄取能力,镜头的进光量可以用F值表示。F值=f(镜头焦距)/D(镜头的有效光圈口径),它与口径成反比,与焦距成正比。也就是镜头光圈的增大可有效提升进光量,从而使摄像机获得理想 的低照度效果。在焦距相同的条件下,选择光圈口径越大的镜头,镜头进光 量就越大,也就是需要选择F值越小的镜头。

下图是国内二家公司的摄像机在照度为1Lux的测试环境中呈现的图像,显然F0.9的B公司图像要好于A公司的F1.0

- 2、图像传感器

CIS(CMOS Image Sensor)图像传感器有过几次技术飞跃,特别是背照式结构大大提高了低照度性能,在2010年之前,流行1/4”传感器。到2015年左右,1/3”传感器得以普及。 2020年后,则出现了越来越多采用1/2”、1/1.8”、1/1.2”靶面的摄像机;传感器尺寸变大,有利于提高低照度性能。随着分辨率的提高,传感器的低照度性能要求也在不断提高,如果完全依赖后期图像信号处理很难得到令人满意的低照度性能。

- 3、ISP图像处理芯片

在AI-ISP技术出现前,夜视领域的玩家们更多在硬件上想办法,实现更低的照度。上世纪90年代索尼便已进入低照度全彩夜视领域,率先研发背照式、堆栈式CMOS图像传感器 。针对感光芯片进行工艺上的改进不断减少电路所占的面积,同时增加感光芯片的感光面积,推出全画幅感光芯片。但材料学及制造工艺难以突破,硬件制约下的视觉成像系统,成像效果已接近天花板。短期内,通过硬件提升光照度,难度显而易见。

2018年,英特尔实验室针对这一世界级难题提供了一条新的路径,提出可以通过整个神经网络实现ISP的全部功能。ISP作为一系列图像处理算法的集合,负责完成图像RGB数据的转换,过程包括各种矫正、去噪、转换和增强等环节。然而,随着复杂场景越来越多,图像处理要求越来越高,传统ISP局限性越来越明显;不断扩充的参数库,带来调试上的困难,整体开发周期逐步拉长。以AI技术为辅助,通过深度学习海量场景和数据,输出算法模型,对图像进行精准处理,则可以在某些场景大幅改善传统ISP的成像效果。基于AI-ISP夜视技术实现全彩夜视的技术路径产品,得到端侧大算力的支持后,全新的ISP成像体系为摄像机提供一个新的大脑。

新一代AI全彩夜视摄像机

升默机器人超级夜视摄像机使用使用大光圈镜头,搭配大靶面传感器,自带强大神经网络处理器(NPU),基于对微光图像信号的分析,利用神经网络深度学习噪声和信号的分布特性,深度学习的降噪技术采用全新的算法架构,训练好各种噪声数据,可以更好的区分噪声和细节、运动和非运动区域,改善传统算法的运动拖尾问题。

通过 “软硬兼施 ”,滤光、补光、曝光、降噪、配准、融合等一系列专利技术组合采用基于深度学习的降噪技术,实现兼具图像清晰度和色彩还原度,相机最大功耗6W,在最低照度0.0001Lux时仍可生成高质量全彩画面。产品兼容性良好,支持ONVIF2.0与GB/T28181-2016协议,支持H.264编码,可快速接入各种第三方系统。